德尔福连续3年在CES演示无人车,2018年也不例外,与谷歌或百度的无人车不同,德尔福(现在叫安波福)的无人车对车的改动最小,最接近我们常见的有人驾驶车。

从外观看,这是一辆宝马530e PHEV,宝马5系纯燃油车与PHEV插电混动外观最大的区别是前脸。

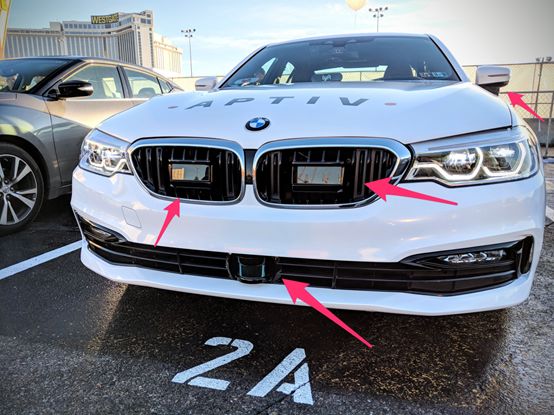

上图是APTIV改装的这辆无人车的前脸,我们可以看到两个IBEO的4线或8线激光雷达,一个Velodyne的16线激光雷达。

上图为燃油车版的2017宝马5系,两者前脸有明显的区别。推测安波福使用的是宝马530e PHEV,顺便说一句,这款车在2018年1月已正式在华晨宝马投产。车辆综合油耗低至百公里1.9升,完全满足中国新能源车产业引导政策。目前该车型已列入工信部《新能源汽车推广应用推荐车型目录》,将于2018年初上市并有望享受中央及地方的各项优惠政策。车辆采用2.0升双涡管涡轮增压发动机及高效电动机,系统最大输出功率为185千瓦,综合扭矩高达420牛米。其搭载的高能量密度动力电池不仅可以提供61公里的纯电续航里程, 也可在发动机完全不用启动的纯电动模式下将车辆加速至140公里/小时。

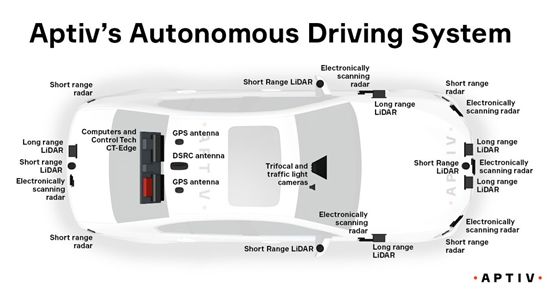

上图为安波福的传感器配置。配备9个激光雷达,包括5个IBEO长距离激光雷达,4个Velodyne 16线短距离激光雷达。一个三目摄像头和一个交通灯识别摄像头,6个长距离毫米波雷达,4个短距离毫米波雷达。

两个GPS天线,推测可能是用了GPS RTK。一个DSRC天线,也就是V2X天线。不过估计只是V2V,V2I需要赌城的交通市政部门协助,未来DSRC最基本的V2I功能就是提供交通信号灯的信息,届时,就无需单独一个交通灯识别摄像头。可以通过V2I直接告知车辆交通信号灯的状态。

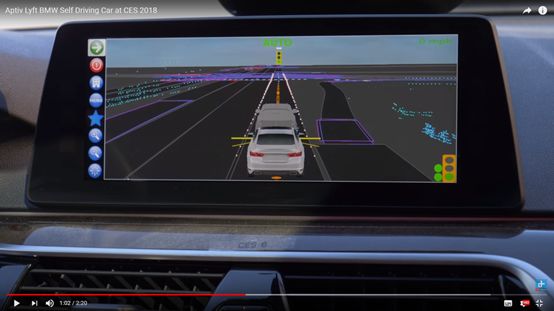

上图是安波福无人车演示时,中控所显示的内容。根据这个显示内容可以推测安波福无人车的技术路线。这种技术路线是用激光雷达建立道路模型并预测其他车辆运动轨迹,同时用激光雷达建造的道路模型配合高精度地图预测自车的运动轨迹。尽量保持在车道中心线行驶,降低路径规划和行为决策的算法规模,降低运算系统负担。用视觉识别行人或骑车人等比较小体积的交通元素,对于比较大体积的车辆,可能还是用激光雷达识别的。

这种技术路线高度依赖车道线,也就是必须是结构化道路,在没有车道线的路段很难自动驾驶,安波福也坦承这是SAE L4级无人驾驶,L5级无人驾驶预计在2020-2021年推出。丰田、谷歌和百度以及可能开发无人车的苹果,则是不仅用昂贵的多线的高清晰度激光雷达来构建道路模型,同时路径规划和行为决策算法规模复杂庞大,可以对应非结构化道路。同时,丰田、谷歌、百度和苹果都还用激光雷达识别车辆、行人、骑车人等交通元素,当然这需要至少64线级的激光雷达配合。安波福考虑运算量、外观风阻、成本,采用了折衷的方案。

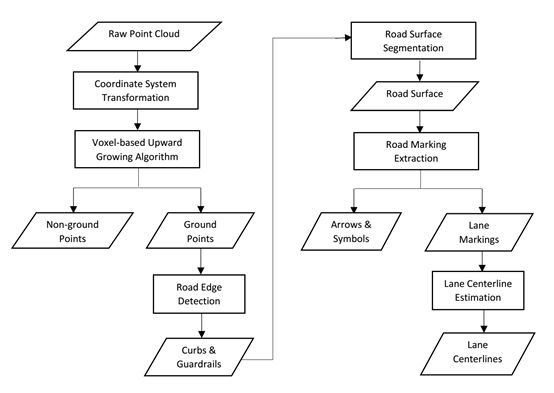

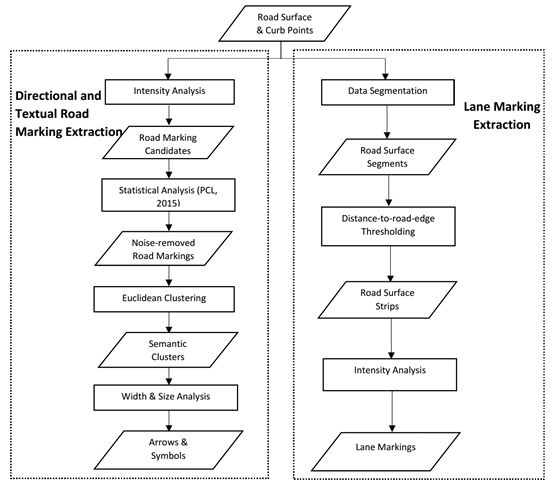

构建道路模型实质上就是构建一个3D的高清晰度地图。只不过这个地图是矢量的,没有语义信息。用激光雷达构建道路模型一般分三步走,第一步识别道路边缘,抽出道路,也就是Road Surface Segmentation。第二步,抽出道路表面标记,即RoadMarking Extraction。第三步,构建地图或模型。流程见下图。

Road Surface Segmentation最常见的方法就是用激光雷达来做,算法非常成熟,鲁棒性远高于视觉,消耗运算资源也远低于视觉。

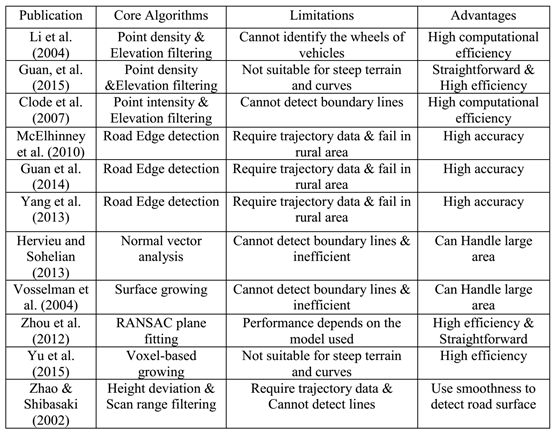

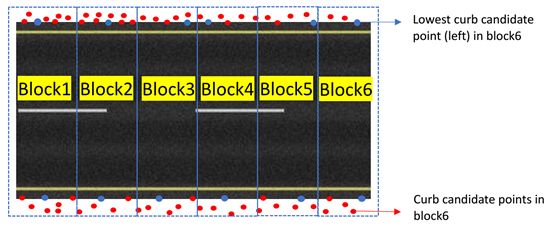

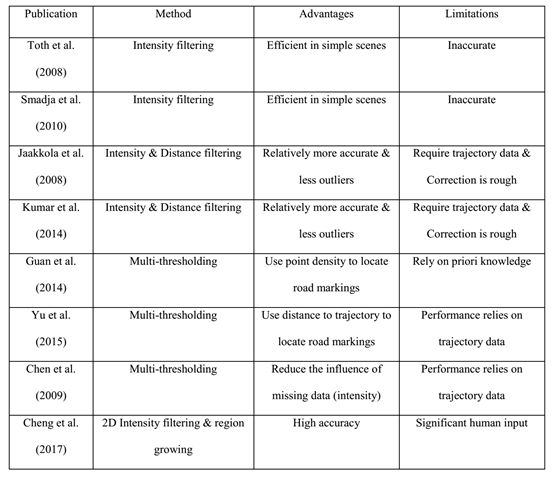

上表为常见的使用激光雷达做Road Surface Segmentation的方法,其中利用点密度与高度滤波器的方法最为成熟,简单明了,消耗运算资源最小。缺点是在非常陡峭的路段无法使用,因为高度变化过于剧烈。还好,结构化道路都不会有陡峭到无法识别的地步。RANSAC平面拟合法也比较优秀,也可以对应非结构化道路、陡峭和急弯路段。考虑到德尔福和英特尔、Mobileye、宝马结盟,对RANSAC运用应该更熟练,更有可能是RANSAC法。

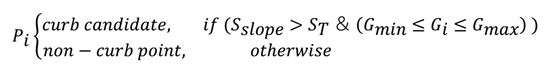

用点云密度与高度滤波器的方法简单原理如上公式。Sslop是连续两个点的斜率,St是自定义的斜率阈值,Gi指两个扫描点之间的高度差值,Gmin是最小高度阈值,Gmax是最大高度阈值。

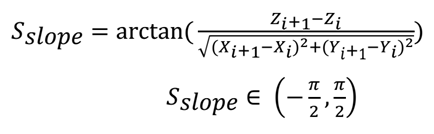

(Xi, Yi, Zi)和(Xi+1, Yi+1, Zi+1)是连续两个点的坐标,用此方法计算出连续两个点的斜率和高度差值。就可以计算出路沿。如下图。

RANSAC为Random Sample Consensus的缩写,它是根据一组包含异常数据的样本数据集,计算出数据的数学模型参数,得到有效样本数据的算法。它于1981年由Fischler和Bolles最先提出。用在激光雷达领域,是根据激光雷达灰度成像点增强,在平面拟合出道路边缘。

上图为一张激光雷达灰度成像图。几乎和光学成像相差无几。RANSAC算法经常用于计算机视觉中。例如,在立体视觉领域中同时解决一对相机的匹配点问题及基本矩阵的计算。

根据道路模型方法,推测安波福的长距离激光雷达极有可能是IBEO的8线激光雷达LUX 8L。因为IBEO对LUX 8L的典型应用是这样描述的,Object Recognition&Terrain Mapping/Ground Scanning at the sametime。LUX 8L有效距离是200米,10%低反射率也可以到50米的有效距离。

第二部是抽出道路标记。

抽出道路标识的常见算法见上表。一般路段,用简单的激光反射强度滤波即可。复杂路段可以加上距离滤波器。流程如下图。语义识别可以用简单的模型库,道路上的语义信息毕竟很少。

最后,对于路上的竖立的离车比较远物体,可以用一种下取样就是VOXEL的方法来提高运算效率。很多时候我们不需要有太过高的分辨率,因为点云过多会造成计算变慢,并且更加消耗计算资源,所以我们需要把点云变稀,voxel就是一个很好的方法。voxel就是三维的pixel,也就是把点云画出网格,然后每个网格内保留一个点就可以了。网格的大小可以自己定义,这就相当于一个downsample(下采样) 。当然如果激光雷达线数低,点云数据就接近VOXEL了。

安波福的无人车似乎可以准确得出其他车辆的3D轮廓图和深度图,而安波福也没用采用结构光的形式来设置摄像头。推测,安波福是用激光雷达识别车辆的,激光雷达识别车辆的另一个优势是可以预测出车辆的运行轨迹,这部分应该主要由16线激光雷达负责。对于比较小体积的行人或骑车人,安波福用的激光雷达云点不够密集,用其识别难度比较高,应该是由安波福的三目摄像头来识别,三目的本质还是单目,只不过增加了视角宽度而已。

安波福单独设置了一个摄像头来识别交通信号灯,这是因为目前车载摄像头的像素数都不高,最多也就是2百万像素,常见的多130万像素,要想准确识别100米外的交通信号灯难度不小,可靠性不高。索尼在2017年10月推出的IMX324,像素高达742万像素,索尼声称在FOV 32度镜头的帮助下可以拍摄距离摄像头最远达160米的路标。不过目前IMX324还未通过最基本的AEC Q-100 2级标准,在车上用的话,最快也要3年了,并且价格非常昂贵,至少是目前130万像素传感器的5倍以上。安波福可能用了一个工业级的800万像素摄像头来专门识别交通信号灯。

至于毫米波雷达系统,跟通用的无人车一样,推测也是作为冗余系统。而短距离毫米波雷达很有可能也是76-81GHz雷达。博世和德尔福都在和美国FCC申请将76-81GHz用做车用波段。

安波福投资了两家固态激光雷达公司,一家是以色列的INNOVIZ,另一家是加拿大的Leddartech。未来可能用这两家公司的固态激光雷达取代IBEO或Velodyne。客户很有可能是宝马或沃尔沃。

安波福同时也是英特尔的盟友,英特尔的自动驾驶方案以摄像头为核心。但是这款安波福的无人车系统却以激光雷达为核心,表明业界领先TIER1往往在多条技术路线上同时下注。