3月20-21日,由佐思产研、佐智汽车主办,地平线、TTTech、魔智、海信网络科技、晶众股份、芯仑光电、PLK、中科慧眼等单位支持的2018第三届ADAS与自动驾驶国际论坛在上海银星皇冠假日酒店举办。超过400多位嘉宾参加了本次论坛,中科慧眼的CTO崔峰发表了《多维视觉在智能驾驶中的应用》的主题演讲。

中科慧眼CTO崔峰

崔峰:各位朋友大家好,我是来自中科慧眼的CTO崔峰。特别荣幸参加这次论坛,从昨天到现在为止有很多嘉宾谈到了双目视觉,这也从一个侧面反映了车载立体视觉的热度。双目视觉既可以狭义地定义成立体视觉,也可以有各种广义的解释,不同的焦距、视角组成的双相机系统也是双目视觉。另外,我们不必把双目相机跟单目相机割裂开,立体相机的关键技术点在于双目立体匹配,2D单相机的关键技术点在于目标的识别,它们之间的可以通过融合构成多维视觉。

中科慧眼致力于为国内外厂家提供多维视觉解决方案,公司从成立到现在三年多,主要致力于双目相机的研发。去年年初我们获得了由中国汽车百人会组织的全球创新创业大赛的第一名,并有幸成为百度阿波罗生态的首个视觉传感器成员,继而获得了Apollo基金的投资。

我们的团队来自于中国科学院自动化所、丰田、微软、诺基亚等公司,技术涵盖了视觉传感器的各个方面,我们力争成为国内一流的视觉传感器创业公司。

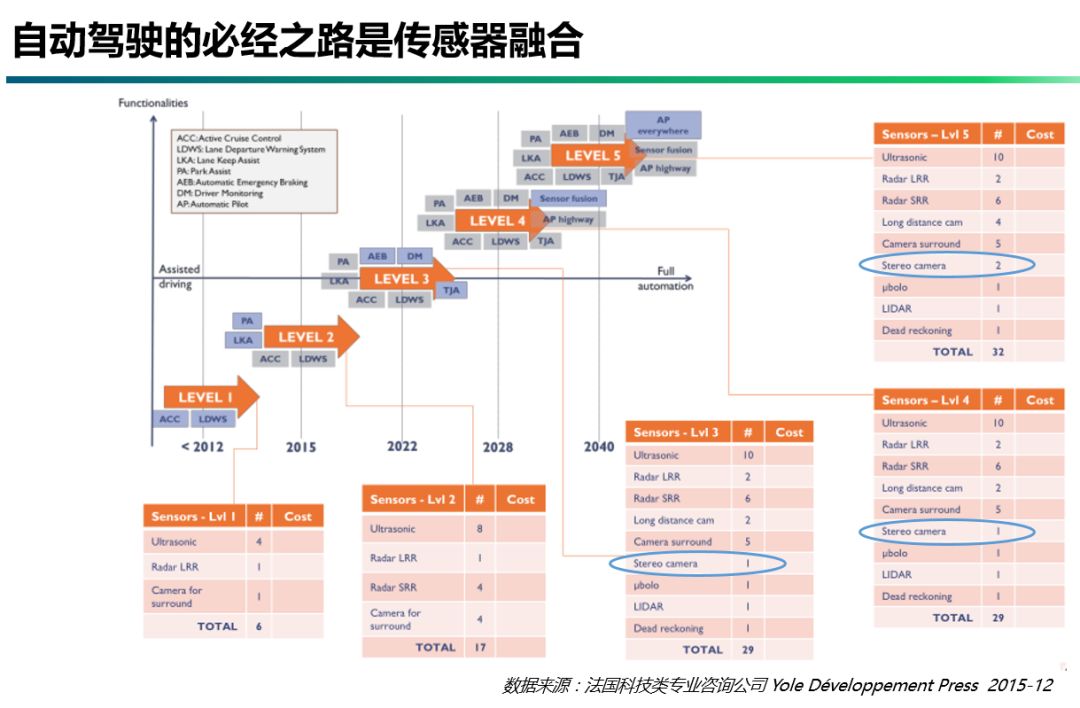

下图是法国的一家咨询公司做的,系统分析了在自动驾驶的不同等级上需要哪些传感器及各自的数量。我们发现随着智能驾驶等级的提高,传感器的种类和数目会越来越多。单就视觉来讲,单纯环视或者2D视觉已难以满足L3以上的需求,这时候多维立体视觉的需求会凸显。

刚才佐思的周老师也提到,不仅是捷豹路虎,从奔驰C/E/S系列,到宝马5系、3系、7系,从高端、中端、到普通车型,都大量装配了立体相机。目前的车载立体视觉设备提供商基本来自日本和欧洲。

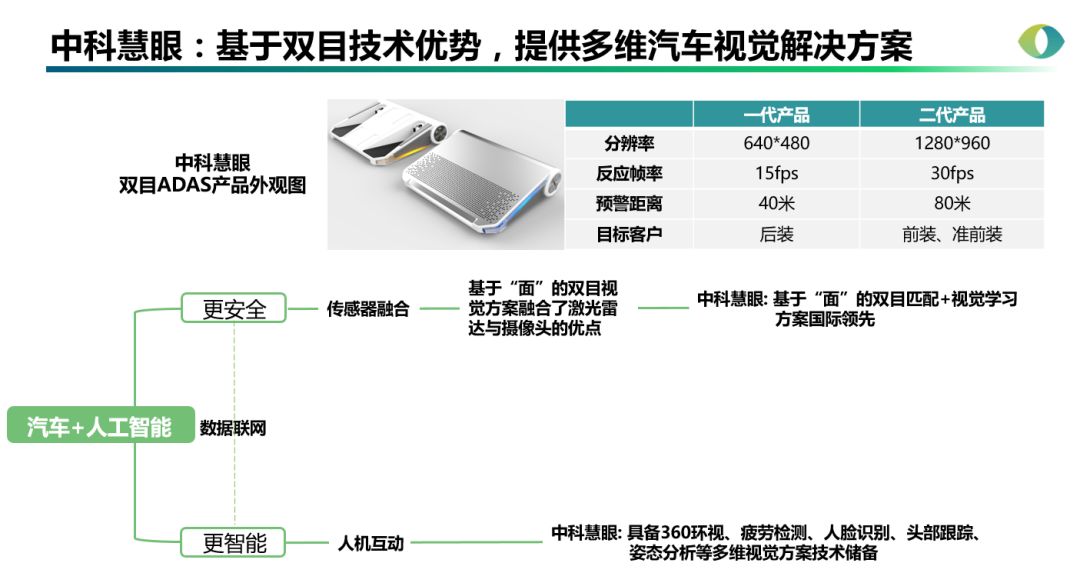

我们希望作为国内立体相机多维视觉的创业公司,为大家提供具有完全自主知识产权的一流产品。目前我们已经推出了两代车载立体视觉产品,第一代产品基于英伟达的GPU架构。现在我们已经向很多客户,尤其是阿波罗客户提供基于车规级的FPGA平台的二代产品,专为前装设计并且成本有效降低。

中科慧眼的产品首先有自主知识产权的算法架构,它超越了目前常见的立体匹配算法,并完全工程化。我们基于成本可控的FPGA平台,获得密集的深度点云,把传统的目标识别、驾驶员疲劳检测,以及未来要做的360环视,或者多视角、多焦段的环境感知集合在一起,做成一个更加开放、更加全面的视觉生态。当然,这也离不开与研发毫米波雷达和激光雷达的朋友一起合作,做多传感器融合。

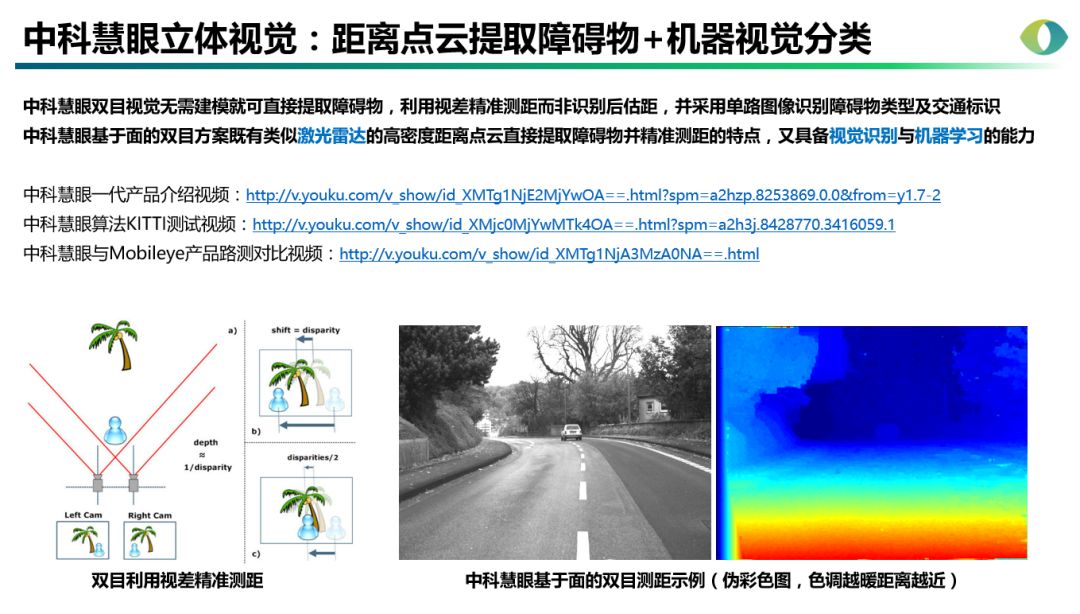

先简单介绍一下立体相机的关键特点,也就是立体匹配。假设自然界里有远和近的物体,分别通过两个平行等位的相机成像,近的物体在两个相机成像位置差距会比较大,远的物体成像位置差距比较小,通过这样的视觉差异大小关系我们得到了自然界中任何一个物体离相机的远近关系。再利用三角测量原理,把每一个点离相机的距离测算出来,并将距离值赋予伪彩色,越近的点越红,越远的点越蓝,我们就得到了用伪彩色表示的深度图。因为我们的算法是密集匹配的方案,所以深度图像超高线束的激光雷达扫描的结果。我们知道智能驾驶常用的激光雷达报价要几万美金起,我们的报价在100—200美金左右,这就有了做车载双目立体视觉的价格空间。

(播放视频)这个视频是我们在场地里静态测距的一个实验,这是立体相机通过WIFI传回手机的实时点云图,而有了密集准确的深度点云,各种道路和障碍物信息可以比较容易地被算法提取出来。立体相机进行路面检测、行人车辆检测以及其他障碍物检测的算法比较简单,可以通过大概500、600M Hz 频率的CPU达到实时检测。立体相机、单目相机、雷达和毫米波各有所长,每项技术都有它的优缺点,在检测小目标以及检测非标准障碍物目标,非标准姿态障碍物目标时,立体相机有它的独特优势。

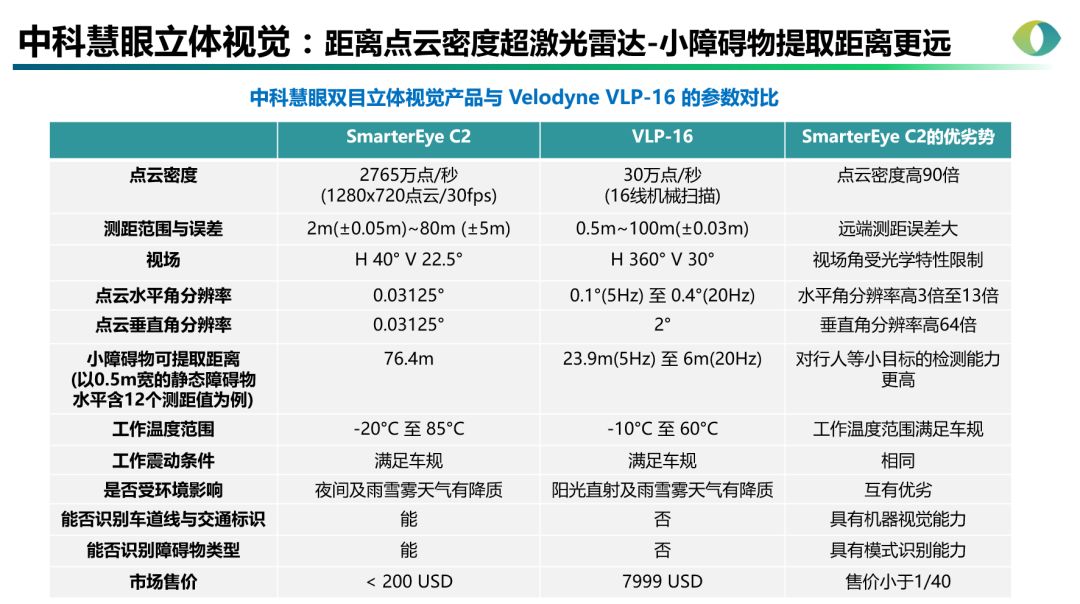

这里我们做了中科慧眼二代产品跟Velodyne 16线以及64线雷达的技术参数对比。360度激光雷达的一个优点是视角宽,而前视双目相机水平视角一般在40—60度左右,但是立体相机的角分辨率非常高,细致到了0.03度,尤其是垂直角分辨率相对机械激光雷达而言非常高。二代立体相机检测成人的距离是70米左右,而16线激光雷达的检测距离在3.9米到6米左右。即使是64线激光雷达,对于人的检测距离在30米左右。

我们认为车载视觉一定有广阔的生存空间。

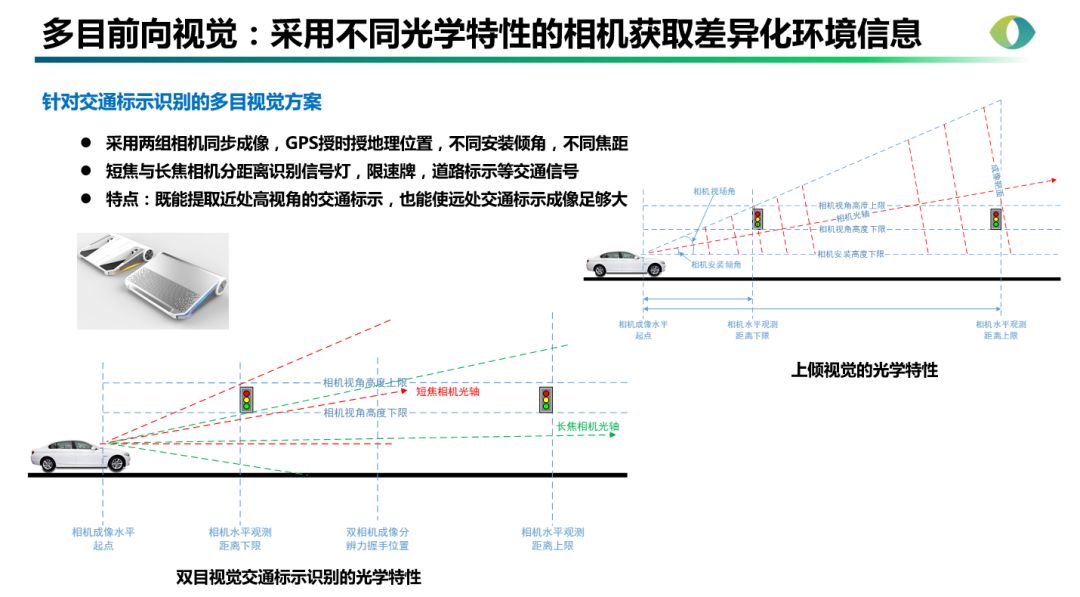

在智能驾驶汽车、无人驾驶汽车上,通过不同焦段、不同仰角的相机可以获得对于不同位置的交通标志、信号灯、各种路标的检测识别能力。举个例子,通过双目相机成像,一个通过广角的近焦相机,一个通过窄角的长焦相机,既可以获得近处高仰角的交通标示信息,也可以获得足够分辨率的远处交通标示成像。如图所示,我们发现长焦相机的成像中,一百米处的红绿灯足够大,一百米处交通标志牌上数字也清晰可见。而短焦相机的成像中,一百米处交通标志牌上的数字完全不清晰。

此外,做车载视觉我们还要解决成像系统在夜间成像能力下降的问题。因为可见光成像在夜间的信噪比较低,我们也在研发远红外的立体成像系统。远红外成像系统的特点是被动的远红外光成像,缺点是远红外相机的接收波长基本上是1微米到8微米,无法穿透车玻璃,这样的话远红外成像系统要放在车外,比如说放在车头进气栅格附近,不容易放在驾驶室里。这种情况下,我们需要前装远红外系统,使得它能实现对夜间生物和发热系统的检测。

既然远红外成像的方式需要改造车辆,我们看能否能不改造车辆进行夜视的增强。下图是近红外成像系统的实验,因为普通的相机传感器对近红外线有一定的响应能力,所以近红外成像对系统的改造比较小。图示是在一个漆黑的夜间,关闭所有灯光,一个120db的相机通过车内近红外补光灯辅助的成像效果。

如果我们打开车内放置的近红外灯,车道线、路面砖块、餐车、自行车都能看到,当然受限于对比度的问题看不太清楚。

我们觉得做视觉不能仅限于做立体视觉和单目视觉,还要做多维度、多角度、多光谱的多维视觉。

去年年底的百度阿波罗大会上,我们联合百度展出了两款产品,一款是用在乘用车上的双目立体视觉相机,一款是用在商用车上的立体相机。

中科慧眼的前装产品正在紧锣密鼓地装配和制造中,我们希望在8月份之前能成为国内第一家产品前装到量产的无人驾驶汽车上的智能视觉传感器公司,欢迎各位朋友到我们公司交流,谢谢大家!

提问:崔总您好,作为阿波罗平台的成员,我看到您PPT上说,你们的二代产品已经给其他阿波罗成员提供产品,我想问你们的产品主要提供给谁?是OEM厂商多一些还是解决方案商多一些?第二个问题,这些成员是主动地联系你们,还是说你们主动?怎么搭建这么一个合作的平台?是阿波罗平台给你们(的机会)?

崔峰:百度阿波罗生态一直努力促使它的平台进入到客车或者乘用车厂家,在阿波罗生态中,我们并不会直接面对车厂,我们作为阿波罗的一个视觉参考硬件合作伙伴,会随着阿波罗系统直接进入到Tier 1厂商的定制系统中。与相机相关的结构也是我们一起参与设计的。

这样我们很早就可以参与设计,不用我们直接去面对Tier 1厂商。

这是中科慧眼2B的一条路线,就是为阿波罗生态企业提供双目相机,并会毫无保留提供校准图像和密集的测距点云。其实无论是阿波罗平台还是其他平台的朋友,都可以通过我们的设备得到良好的成像以及点与点对齐的的距离点云值。这样可以节省大家做相机开发以及双目相机的时间与资源成本,毕竟车载双目相机研发的确难度较大。

第二种合作方案,就是很多厂商希望我们直接提供场景分析检测的数据,譬如提供给车道线和障碍物的检测数据,通过CAN总线或者别的传输方式给他的控制端,省掉自己进行图像和点云分析的过程,进而快速实现智能驾驶系统。

您的第二个问题是如何搭建合作的平台,一方面是直接通过阿波罗系统进入合作车企,这样的情景我们属于配合方;另一方面是我们通过像今天这样的论坛与业内的朋友们交流,获得彼此的认知,还有各类媒体的宣传,进而推动项目的建立与进行。